I. Einleitung

Die Anwendungen künstlicher Intelligenz halten zunehmend Einzug in unseren Alltag. Im Bereich der Medizin geht es um die Optimierung von Diagnose und Therapie, die Nutzung von Gesundheits-Apps verschiedener Ausrichtungen, die Bereitstellung von Instrumenten der personalisierten Medizin, die Möglichkeiten roboterassistierter Chirurgie, ein optimiertes Krankenhausdatenmanagement oder die Entwicklung und Bereitstellung intelligenter Medizinprodukte. Dabei stellt sich bereits die Frage, was unter dem Begriff „künstliche Intelligenz“ (KI) überhaupt zu verstehen ist? Was bedeutet Intelligenz? Diese Fragen werden je nach Kontext und disziplinärer Verankerung äußerst unterschiedlich beantwortet. Unumstritten ist der Befund, dass die Qualität und die Quantität der unter KI firmierenden Anwendungen zahlreiche rechtliche, ethische, soziale sowie auch naturwissenschaftliche Fragen aufwerfen, die bisher noch auf eine umfassende Aufarbeitung warten. Am 06.03.2024 hat die EU-Kommission das erste europäische KI- Gesetz (AI Act) vorgestellt. Bis Ende April 2024 werden die einzelnen EU-Staaten dem Gesetz zustimmen und es soll im Sommer 2026 in Kraft treten. „Was steht im Gesetz?“ Während das Recht bei der Technikregulierung den praktischen Entwicklungen zumeist hinterherhinkt, könnte sie im Bereich der KI zu einem Paradigmenwechsel führen.

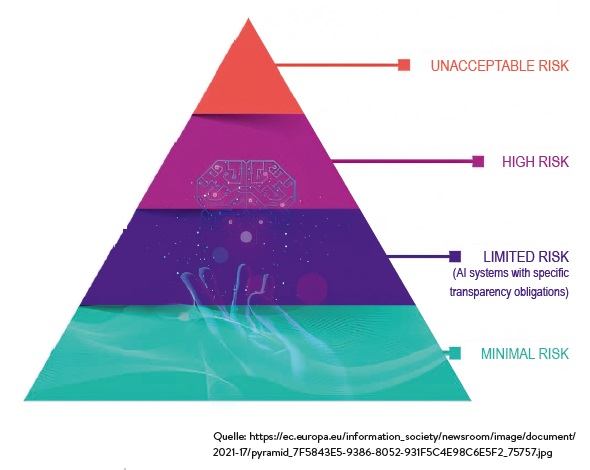

Die neuen Vorschriften legen Verpflichtungen für Anbieter und Nutzer von KI fest, die sich nach dem Risiko des von dem KI-System ausgeht, richten. Verbotsregelungen regeln das sog. unannehmbare Risiko (unacceptable risk). Danach dürfen KISysteme nicht in den Verkehr gebracht werden, die z. B.

- kognitive Verhaltensmanipulationen von Personen oder bestimmten gefährdeten Gruppen,

- soziales Scoring: Klassifizierung von Menschen auf der Grundlage von Verhalten sozioökonomischen Status und persönlicher Merkmale, etc.

beinhalten.

Neben diesem unannehmbaren Risiko werden die anderen Risikokategorien als Hochrisiko-KI-Systeme (High Risk), generative KI und begrenztes Risiko KI (Limited Risk) und minimale Risiken (Minimal Risk) klassifiziert.1

Diese Schutzmechanismen insbesondere für vulnerable Gruppen (z. B. Kinder, Kranke, Demente etc.) sind sicherlich sinnvoll und geboten. Aber macht KI vor den Türen der EU halt? Dies gilt gerade auch für KI-Anwendungen in der Medizin, wenn es z. B. um die KI-basierte Auswahl von Transplantatpatienten geht oder um die Teilnahme an Studien, off-label-use oder compassionate-use von Arzneimitteln. Hier wird totalitären Staaten außerhalb Europas Tür und Tor geöffnet unannehmbare Risiken auf Kosten von vulnerablen Gruppen einzugehen und dadurch wissenschaftliche Erkenntnisse zu gewinnen, die in Europa aus ethischen Gründen zurecht versperrt bleiben. Wie geht dann Europa mit diesem Wissensvorsprung solcher Staaten um?

II. Medizinische Geräte und medizinische KI-Anwendungen sind Hochrisiko-KI-Systeme

Medizinische KI-Systeme und medizinische Geräte, die auf KI-Basis agieren werden als Hochrisiko-KI-Systeme klassifiziert. Der Regulierungsansatz erfolgt horizontal und kohärent, was bedeutet, dass grundsätzlich nicht nur einzelne Lebensbereiche erfasst werden, sondern vielmehr jedes Inverkehrbringen, jede Inbetriebnahme und jede Verwendung von KI-Systemen dem Anwendungsbereich des Gesetzes unterfallen soll.2 Diese horizontale Ausrichtung erfordert sogleich die uneingeschränkte Kohärenz mit dem bestehenden Unionsrecht, wie z. B. der EU-Grundrechtscharta und dem geltenden Sekundärrecht der Union zum Daten- und Verbraucherschutz, zur Nichtdiskriminierung und zur Gleichstellung der Geschlechter. Diese Vorschriften sollen von dem AI-Act unberührt bleiben, aber auch nicht in Widerspruch zu dieser stehen. Der AI-Act enthält in Art. 3 Nr. 1 eine Legaldefinition für den Begriff der künstlichen Intelligenz: Danach ist „System der künstlichen Intelligenz“ (KI-System) eine Software, die mit einer oder mehreren der in Anhang 1 aufgeführten Techniken und Konzepte entwickelt worden ist und im Hinblick auf eine Reihe von Zielen die von Menschen festgelegt werden Ergebnisse wie Inhalte vorhersagen, Empfehlungen oder Entscheidungen hervorbringen kann, die das Umfeld beeinflussen, mit dem sie interagieren.“ Anhang 1 listet dann Techniken und Konzepte der künstlichen Intelligenz auf, wie z. B. Konzepte des maschinellen Lernens, Logik und wissensgestützte Konzepte einschließlich Wissensrepräsentationen induktiver (logischer) Programmierung, Schlussfolgerungs- und Expertensysteme etc. Nach dem AI-Act werden alle medizinisch relevanten Anwendungen als Hochrisiko-KI-Systeme eingeordnet.

III. Folgen der Hochrisiko-KI-Systemklassifizierung für medizinische Anwendungen

Da es sich bei KI-Anwendungen laut der Legaldefinition um Software handelt und Software bei medizinischen Anwendungen immer ein Medizinprodukt ist, stellt sich die Frage, in welchem Verhältnis die Regelungen für Medizinprodukte zu dem EU KI-Gesetz stehen. Aus der Hochrisikoklassifikation folgen zahlreiche und kostspielige Sicherheitsregelungen wie die Etablierung eines Risikomanagement-Systems inklusive Testverfahren, verschiedene technische Dokumentationen und Aufzeichnungsverpflichtungen, die Transparenz und Bereitstellungen von Informationen für die Nutzer, die Etablierung einer menschlichen Aufsicht, die Umsetzung der Prinzipien der Genauigkeit, Cybersicherheit sowie auch sehr spezifische Anbieterverpflichtungen. Dies führt zu einer Konkurrenz mit parallel anzuwendenden Rechtsvorschriften wie die MDR (Medical Device Regulation) als Nachfolge-EU-Verordnung des MPG (Medizinprodukte-Gesetz) sowie die Regelungen der Produkthaftung, die z.Zt. ebenfalls in Form eines Vorschlages der EU-Kommission diskutiert werden und weitreichende Veränderungen vorsehen:

IV. Produkthaftung für KI-Systeme

Die EU-Kommission hat einen Vorschlag für eine Richtlinie über die Haftung für fehlerhaft Produkte (ProdHaftRl-E) am 28.09.2022 vorgelegt, die sich ausdrücklich auch auf KI-Systeme und medizinische Anwendungen bezieht. Diese geplante Regelung ist für die Ärzteschaft besonders bedeutend, da sie die Verbraucherrechte geschädigter Patienten erheblich verbessert, nach hiesiger Auffassung aber – zu Recht – das Haftungsrisiko für Ärzte als Anwender künstlicher Intelligenzsysteme wesentlich verringert. Einige dieser Haftungserleichterungen sollen herausgestellt werden:

1. Fehlerfiktion wegen unterlassener Offenlegung

Art. 8 Abs. 1 ProdHaftRL-E sieht vor, dass der Hersteller eines Medizinproduktes verpflichtet ist, sämtliche Informationen zu seinem Produkt offen zu legen, um den geschädigten Patienten den Zugang zu relevanten Beweismitteln zu ermöglichen. Kommt der Medizinproduktehersteller dieser Verpflichtung nicht nach, wird davon ausgegangen, dass das Produkt fehlerhaft ist.

2. Beweiserleichterung wegen offensichtlicher Funktionsstörung Art. 9 Nr. 2 c) ProdHaft RL-E

Es wird die Fehlerhaftigkeit des Produkts vermutet, wenn der

Kläger nachweist, dass der Schaden Folge einer offensichtlichen Fehlfunktion des Produktes bei normaler Verwendung oder unter normalen Umständen verursacht wurde.

3. Kausalitätsvermutung bei komplexen Produkten

In den Erwägungsgründen dieser geplanten Richtlinie werden KI-Systeme ausdrücklich als komplexe Produkte qualifiziert. Kommt ein Patient infolge der Anwendung komplexer Produkte zu Schaden, wird die Fehlerhaftigkeit dieses Produktes sowie die Kausalität zwischen dem Fehler und den Schaden des Patienten vermutet. Kommt also in Folge der Anwendung eines KI-Systems ein Patient zu Schaden, haftet demnach nicht der das KI-System anwendende Arzt, sondern der Hersteller bzw. Vertreiber der KI-Anwendung.

Es werden z. B. Anwendungen in der Radiologie diskutiert, wonach ein KI-System Auffälligkeiten in einem bildgebenden Verfahren auswerten und diagnostizieren (können) soll. Wird eine solche Auffälligkeit durch ein KI-System nicht erfasst und muss von einem Arzt auch nicht ohne Weiteres erkannt werden, haftet ausschließlich der Hersteller bzw. Vertreiber einer entsprechenden KI-Anwendung. Sofern derzeit schon entsprechende KI-Anwendungen in der Radiologie eingesetzt werden, ist es immer noch der Arzt, der einen letzten Blick auf das Ergebnis wirft.

Auch der Einsatz robotergestützter Chirurgie erfolgt derzeit noch meist im Wege der Interaktion zwischen KI und dem Arzt oder der Ärztin. Allen Prognosen zur Folge werden medizinische KI-Anwendungen zunehmend autonom durchgeführt also unabhängig von dem Menschen, der die Technik nur bedient.

Mit zunehmendem Eintritt der KI in die Medizin, wird sich die Haftungsfrage konsekutiv von der Arzthaftung, also von der Haftung der Ärzteschaft für Behandlungsfehler hin zur Produkthaftung für fehlerhafte KI-Techniken verlagern.

IV. Wofür müssen Ärzte in der „Übergangsphase“ haften?

Die Regelung für KI-Anwendungen (AI-Act) ist zwar geschriebenes EU-Recht, tritt aber erst 2026 in Kraft. Die geplante Produkthaftungsrichtlinie hat noch nicht einmal alle Hürden der EU-Gesetzgebung genommen und wird, anders als der AI-Act als EU-Richtline nicht unmittelbar gelten, sondern Bedarf der Umsetzung in nationales Recht. Mit anderen Worten, es muss auch noch das Produkthaftungsgesetz (ProdHaftG) geändert werden. Da dies erst in 6 Jahren von der EU-Kommission überprüft wird, könnte dies noch einige Zeit dauern. Was gilt in der Zwischenzeit? Wie werden KI-Anwendungen haftungsrechtlich beurteilt? Wie sind Gesundheits-Apps rechtlich einzuordnen.

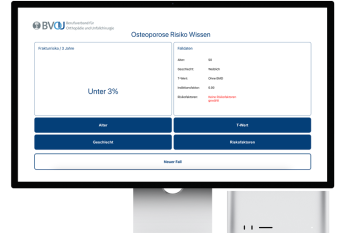

1. Gesundheits-Apps

Sind Gesundheits-Apps immer auch Medizinprodukte? Nein! Die Schwelle zu der Frage, ob eine Gesundheits-APP bereits ein Medizinprodukt ist, ist nicht ganz eindeutig. Es gibt im Grunde zwei Faustformeln: Je risikoreicher eine App ist, desto eher muss diese als Medizinprodukt auf den Markt kommen. Wenn eine App eher die Funktion eines Nachschlagwerkes hat, ist es kein Medizinprodukt. Wenn die APP dagegen eigenständige Gesundheitsdaten auswertet und Vorschläge macht oder Warnsignale abgibt, liegt ein Medizinprodukt vor. Wenn man z. B. die I Watch nimmt, kann diese den Puls messen und den Sinusrhythmus bestimmen. Es wird jedoch mehrfach darauf hingewiesen, dass die Bestimmung des Sinusrhythmus nicht dazu führt, dass mit dieser Funktion ein Herzinfarkt diagnostiziert werden kann. Bei der I Watch handelt es sich um einen Grenzfall, es liegt noch kein Medizinprodukt vor. Anders liegt der Fall bei Geräten, die den Blutzucker bestimmen und bei Über- oder Unterzuckerung ein Warnsignal abgeben. In der Regel ist ein Medizinprodukt an dem CE-Kennzeichen erkennbar, das sich aber auch auf andere Produkte beziehen kann, die zertifiziert werden müssen. Anders als bei Arzneimitteln gibt es bei Medizinprodukten keine staatliche Zulassung. Hier trägt der Hersteller die alleinige Verantwortung.

2. Haftung für Gesundheits-Apps

Für fehlerhafte Medizinprodukte haftet der Medizinproduktehersteller, wobei derzeit noch die für Patienten nachteiligen, strengen Haftungsregelungen gelten, so dass etwaige Ansprüche von Patienten insbesondere häufig an der Kausalitätsfrage scheitern, weil hier die Beweiserleichterungen noch nicht gelten.

Wendet der Patient selbständig Gesundheits-Apps an, die keine Medizinprodukte sind, wie Fitness-Apps, Yoga-Apps etc. dürfte ein Gesundheitsschaden zum allgemeinen Lebensrisiko gehören, es sei denn die App enthält eindeutig falsche Anleitungen.

Der Arzt haftet nur dann für die Anwendung von Gesundheits-Apps, wenn deren Anwendung kontraindiziert ist, nicht aber, wenn die App selbst medizinisch unsinnige Hinweise gibt, die zu einem Schaden führen. Ein Orthopäde/Unfallchirurg haftet auch nicht, wenn er z. B. einem Patienten empfiehlt, etwa die Hüftmuskulatur bei bestehender Hüftdysplasie zu stärken und generell auf Apps verweist, wenn der Patient es übertreibt und einen Schaden erleidet. Denn die Empfehlung ist sinnvoll, die Umsetzung obliegt dann dem Patienten.

V. Zusammenfassung

Es wird diskutiert, welche Chancen und Möglichkeiten KI-Systeme zukünftig bieten werden. Hier wird davon ausgegangen, dass viele Anwendungen, die derzeit noch in der technischen Diskussion sind, zukünftig bereitgestellt werden können. Diese dürften für die Anwender, sprich die Mediziner Chancen bieten, das medizinische Niveau sowie die Patientensicherheit und den Nutzen für Patienten zu verbessern. Haftungsrechtlich dürften die Ärzte und Ärztinnen als Anwender eines KI-Systems zu Lasten der Hersteller dieser KI-Systeme haftungsrechtlich entlastet werden so bald auch die geplante Produkthaftungsrichtlinie Rechtswirklichkeit wird.

______________________________

Quellen:

1 Vgl.: www.digital-strategy.ec.europa.eu/de/policies/regulatory-framework-ai

2 Art. 8.1 lit. a) AI